新闻动态

news dynamic

发布日期:2026-04-02

3月30日,天津大学医疗机器人与智能系统研究院开展2026年第四期研究生阅读报告分享会,5名研究生依次进行了阅读报告分享。

研究院2024级博士研究生范宣泽围绕《膝关节周围截骨术前个性化手术规划系统的研究》进行报告分享。

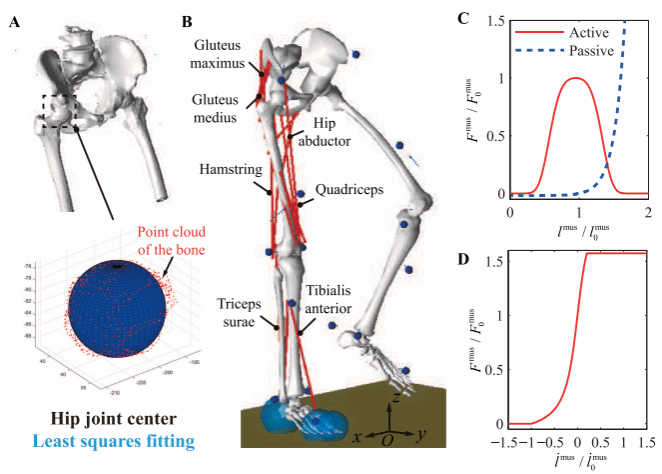

全髋关节置换(THA)术后假体位置不佳是术后功能受限的首要原因,北理工团队和积水潭团队围绕全髋关节置换术(THA)髋臼杯精准定位开展了相关研究。团队首次建立了基于术前多源数据的THA个体化规划框架,实现了运动学—动力学双约束(KKC)的髋臼杯定位方法,填补了领域空白。方法利用PSSZ在运动学硬约束先确定假体放置大致区域,然后通过动力学优化,最大化臼杯法向量与步态周期内髋关节压缩冲量的点积和整个步态周期接触斑到杯边缘的距离,消除边缘载荷风险。

该研究用定量数据证明了通用Lewinnek安全区的局限性,为临床摒弃 “一刀切” 的规划标准、推广个体化功能规划提供了核心证据。同时,优化了个性化肌肉骨骼建模的流程,通过 NICP 算法实现了肌肉附着点的自动化配准,兼顾了模型精度与计算效率,具备临床落地的可行性。

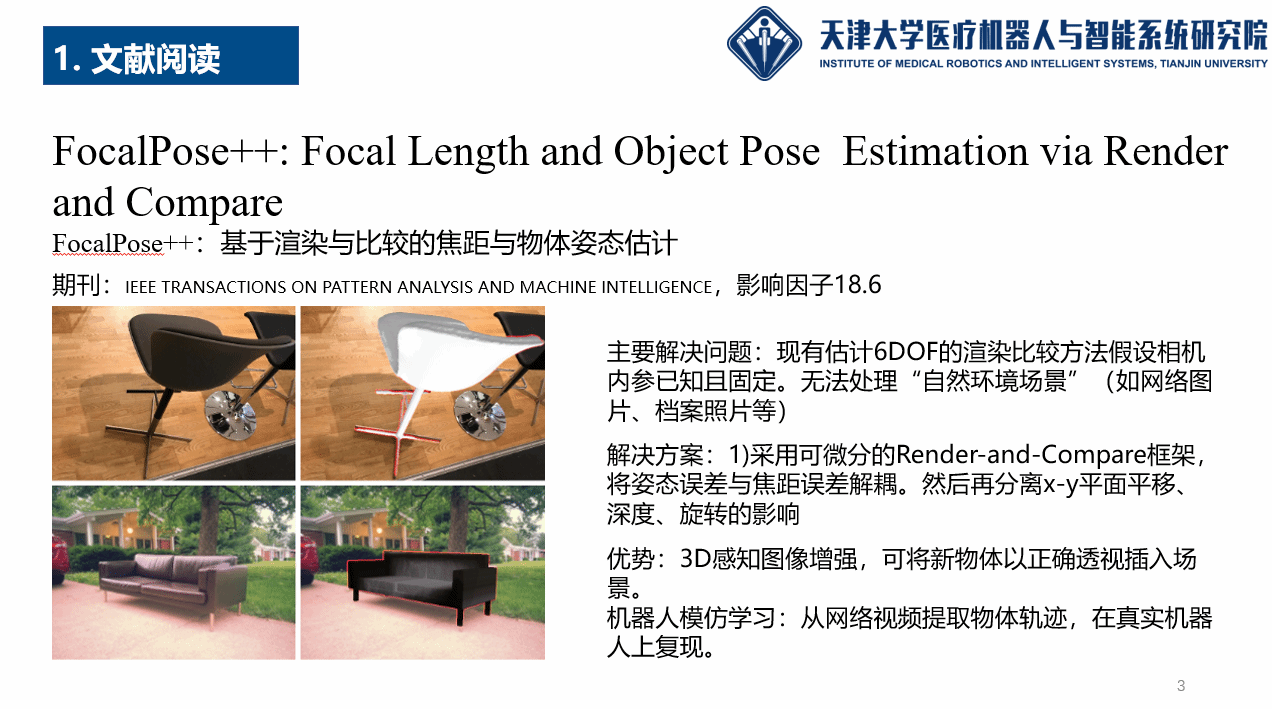

研究院2024级博士研究生张守威分享了论文《FocalPose++: Focal Length and Object Pose Estimation via Render and Compare》。

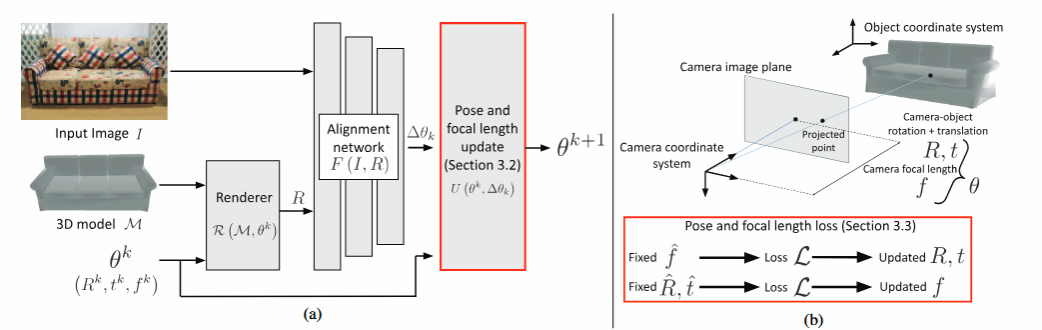

在计算机视觉领域,6D物体位姿估计是增强现实(AR)和机器人技术的基石。传统的“渲染与比较(Render-and-Compare)”方法(如CosyPose)通常假设已知相机内参(焦距等),在面对未标定相机展现的网络图片、档案照片等“野外(In-the-wild)”场景时,存在难以区分相机焦距或物体深度变化的问题。

FocalPose++通过联合估计6D位姿与焦距,打破了“必须已知内参”的束缚。该方法构建了一个可微分的框架,其核心在于解耦损失函数与新的位姿更新规则。联合估计任务中,方法引入了解耦重投影损失和解耦位姿损失。Pix3D、CompCars等数据集上的实验证明,FocalPose++的精度远超现有SOTA方法。在视频录制设备的参数完全未知情况下,机器人可以直接从互联网视频中提取物体的运动轨迹,并在真实世界中精准复现。FocalPose++证明了将位姿参数解耦是提高估计准确度的关键,为处理完全无标定的复杂自然场景提供了成熟的方案。

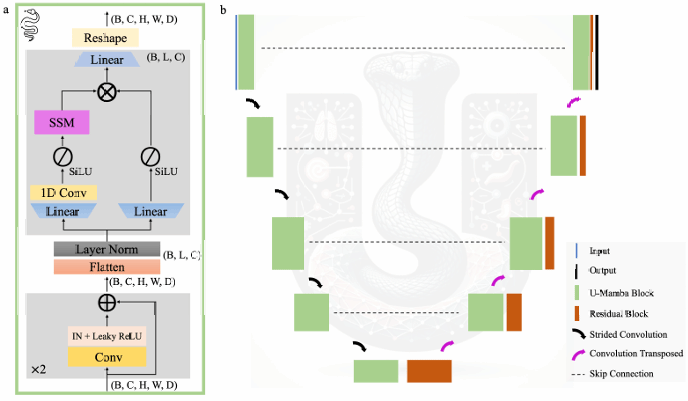

研究院2024级硕士研究生魏鹏飞进行了题为《U-Mamba:增强生物医学图像分割中的长距离依赖关系》的报告分享。

目前,卷积神经网络(CNN)和Transformer是生物医学图像分割领域主流的两种架构。CNN受限于卷积核的局部性,难以充分捕捉图像的全局上下文信息。Transformer擅长处理长距离依赖,但其自注意力机制的计算复杂度呈平方级增长,在处理高分辨率的医学图像时往往会消耗极大的计算资源。

为了突破上述局限,研究团队提出了一种全新的通用网络架构——U-Mamba。架构的核心是设计了混合的CNN-SSM模块,该模块不仅继承了卷积层提取局部细粒度特征的强大能力,还巧妙地融入了Mamba捕捉长距离依赖的优势,可实现局部细节与全局上下文的有效结合。同时,U-Mamba具有自我配置机制,能够无需人工干预地自动适应各种不同的数据集。研究人员在四个截然不同的医学图像分割任务上对U-Mamba进行了全面评估。结果表明,U-Mamba在所有任务中均大幅超越了现有的基于CNN和Transformer的先进分割网络。在处理外观异质性较强、边界复杂的软组织时,U-Mamba展现出了更强的鲁棒性,显著减少了分割误差。这项研究不仅为生物医学图像分析中高效的长距离依赖建模开辟了新的方向,也充分展示了Mamba架构在视觉任务中的巨大潜力。

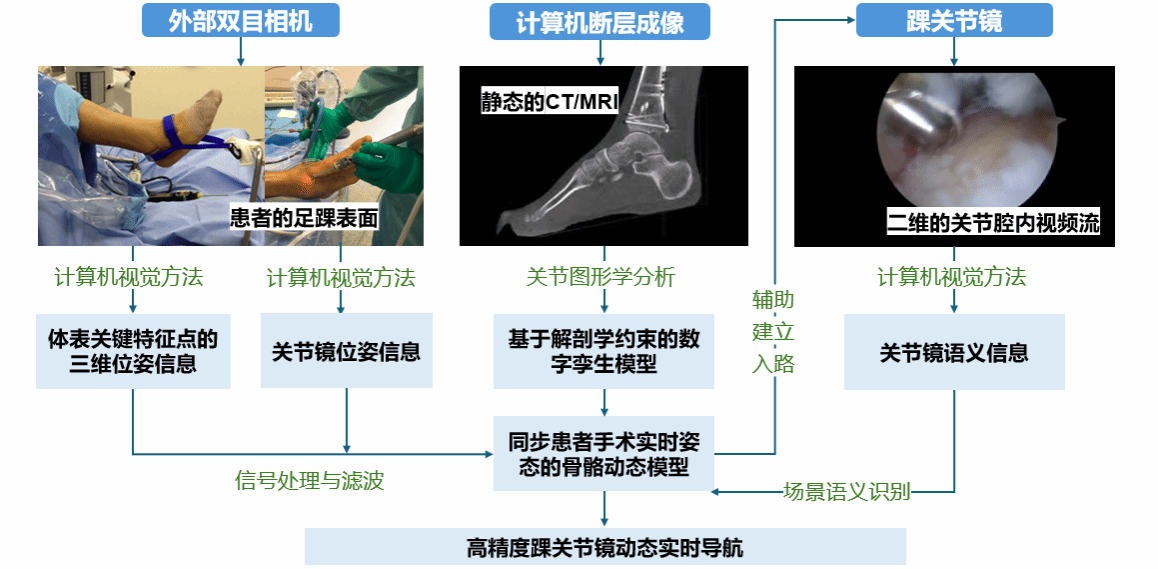

研究院2024级硕士研究生李玉龙围绕《踝关节镜跨模态影像定位导航研究》进行报告分享。

针对手术中频繁遮挡导致追踪中断的问题,发表于IEEE VIS 2026的一篇关于设备无关型手术器械追踪框架的研究论文提出了动态场景图和位姿图优化方法。该方法通过寻找替代运动学路径实现被遮挡物体的持续渲染,可显著提升追踪精度和抗遮挡能力。

踝关节镜手术空间狭小且结构复杂,高度依赖医生经验。跨模态影像导航能够打通实时姿态、整体解剖与局部细节的信息壁垒,具有重要的临床价值。在最新进展中,研究人员构建了面向足踝关节镜手术的增强现实智能导航系统,通过外部双目相机实时获取体表与器械信息,并利用轻量化的Ankle-Pose网络实现高精度足踝跟踪。针对术中软组织伪影造成的位姿抖动,研究引入了基于个体解剖学的旋转轴约束,将观测运动投影至生理可行空间以增强稳定性。同时,通过质量加权多面融合与自适应平滑算法,关节镜位姿追踪的精度和稳定性分别提升17.5%和17.1%。结果表明,该系统通过数字孪生技术实现了多视角联动可视化,可为医生提供宏观全景与微观细节的统一感知。

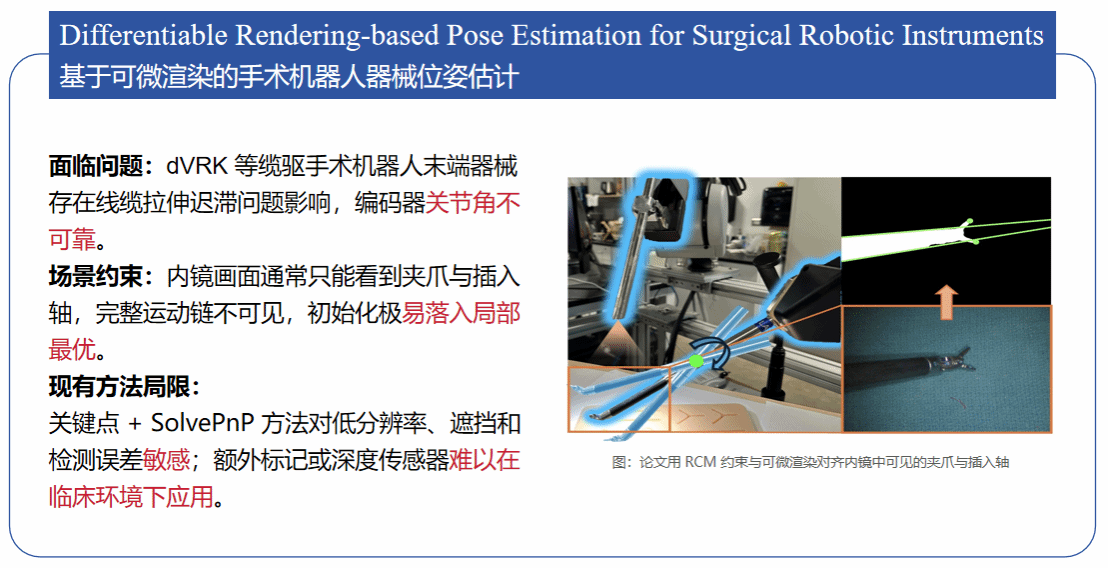

研究院2024级硕士研究生李俊杰进行了题为《时空隔离环境下的手术机器人作业行为预测方法研究》的报告分享。

达芬奇研究平台等缆驱式手术机器人在线缆拉伸、迟滞效应影响下,编码器反馈关节角存在误差、难以直接反映真实末端状态。针对此问题,美国加州大学团队聚焦器械位姿估计,提出了一种基于可微渲染的无标记单次标定方法。该方法将器械位姿估计转化为“图像轮廓—渲染轮廓”之间的匹配问题,由分割模型提取器械参考掩膜,并结合器械CAD模型、前向运动学与可微渲染,在相机坐标系下生成候选姿态的轮廓结果。

在优化目标上,方法不仅考虑渲染轮廓与真实轮廓之间的图像级匹配误差,还引入了几何约束来增强对器械结构特征的刻画。通过“候选排序—粗优化—精细优化”流程,最终输出更准确的相机到机器人位姿变换,并同步校正末端可见关节角。论文利用器械绕RCM运动的特性,对多次估计所得插入轴进行汇聚分析,并进行了纱布和缝针抓取实验。结果显示,该方法在标定一致性方面明显优于传统PnP初始化方案,在真实抓取任务中展现出较好的实用价值。总体而言,这项工作为手术机器人视觉标定、自动操作以及后续实时跟踪研究提供了一条具有较强鲁棒性和应用潜力的新路径。

文献来源:

[1] Jianqiao Guo a, Hao Tang, et al. Kinematic–kinetic compliant acetabular cup positioning based on preoperative motion tracking and musculoskeletal modeling for total hip arthroplasty [J]. Journal of Biomechanics, 2024, 112332.

[2] Cífka, Martin, Ponimatkin G ,Labbé, Yann,et al.FocalPose++: Focal Length and Object Pose Estimation via Render and Compare[J].IEEE Transactions on Pattern Analysis and Machine Intelligence, 2023.DOI:10.1109/TPAMI.2024.3475638.

[3] Ma J, Li F, Wang B. U-mamba: Enhancing long-range dependency for biomedical image segmentation[J]. arXiv preprint arXiv:2401.04722, 2024.

[4] Zhang J, Liu M, Shu H, et al. Extend Your Horizon: A Device-Agnostic Surgical Tool Tracking Framework with Multi-View Optimization for Augmented Reality[J]. arXiv preprint arXiv:2603.07981, 2026.

[5] Liang Z, Chiu Z Y, Richter F, et al. Differentiable rendering-based pose estimation for surgical robotic instruments[C]//2025 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS). IEEE, 2025: 20898-20905.